Tag: SEO

Mitte der 1990er Jahre fingen die anstehenden Suchmaschinen im Internet an, das frühe Web zu katalogisieren. Die Seitenbesitzer erkannten direkt den Wert einer nahmen Positionierung in den Serps und recht bald entwickelten sich Einrichtung, die sich auf die Besserung qualifizierten.

In den Anfängen passierte der Antritt oft bezüglich der Transfer der URL der jeweiligen Seite in puncto verschiedenen Suchmaschinen im Netz. Diese sendeten dann einen Webcrawler zur Kritische Auseinandersetzung der Seite aus und indexierten sie.[1] Der Webcrawler lud die Website auf den Web Server der Suchseiten, wo ein 2. Angebot, der sogenannte Indexer, Informationen herauslas und katalogisierte (genannte Wörter, Links zu diversen Seiten).

Die damaligen Modellen der Suchalgorithmen basierten auf Informationen, die mit den Webmaster eigenständig vorhanden sind, wie Meta-Elemente, oder durch Indexdateien in Search Engines wie ALIWEB. Meta-Elemente geben eine Gesamtübersicht via Gegenstand einer Seite, doch registrierte sich bald raus, dass die Einsatz er Hinweise nicht zuverlässig war, da die Wahl der gebrauchten Schlagworte durch den Webmaster eine ungenaue Erläuterung des Seiteninhalts widerspiegeln hat. Ungenaue und unvollständige Daten in Meta-Elementen vermochten so irrelevante Seiten bei speziellen Stöbern listen.[2] Auch versuchten Seitenersteller verschiedene Attribute in einem Zeitraum des HTML-Codes einer Seite so zu lenken, dass die Seite größer in den Resultaten gelistet wird.[3]

Da die neuzeitlichen Suchmaschinen sehr auf Gesichtspunkte angewiesen waren, die nur in Taschen der Webmaster lagen, waren sie auch sehr unsicher für Delikt und Manipulationen in der Positionierung. Um höhere und relevantere Vergleichsergebnisse in Serps zu bekommen, mussten sich die Anbieter der Suchmaschinen im Internet an diese Umständen adaptieren. Weil der Riesenerfolg einer Recherche davon anhängig ist, wesentliche Suchergebnisse zu den gestellten Suchbegriffen anzuzeigen, konnten untaugliche Vergleichsergebnisse dazu führen, dass sich die Benutzer nach anderweitigen Chancen bei dem Suche im Web umsehen. Die Lösung der Suchmaschinen im Netz fortbestand in komplexeren Algorithmen beim Rangordnung, die Punkte beinhalteten, die von Webmastern nicht oder nur mühevoll manipulierbar waren. Larry Page und Sergey Brin entwickelten mit „Backrub“ – dem Urahn von Suchmaschinen – eine Suchseiten, die auf einem mathematischen Suchalgorithmus basierte, der anhand der Verlinkungsstruktur Seiten gewichtete und dies in Rankingalgorithmus reingehen ließ. Auch zusätzliche Suchmaschinen im Netz betreffend in Mitten der Folgezeit die Verlinkungsstruktur bspw. in Form der Linkpopularität in ihre Algorithmen mit ein.

Suchmaschinen

Mehr zu: "Make Your Want Come True" || Blibli Rooftalks – Park Search engine optimisation Jun 💙

How To: How To Add Internal hyperlinks in WordPress like a Ninja – web optimization Technique

The right way to Create and Set up Structured Data for Local SEO

Tips on how to create a Google Analytics website positioning dashboard

YouTube search engine marketing Full Guide Tutorial For Learners || Hindi

Mehr zu: Create XML Sitemaps for WordPress using the WordPress web optimization by Yoast Plugin | WP Learning Lab

YouTube website positioning | Make Viral Videos | Get More Views & Subscribers | Finest App for Youtubers – 2017

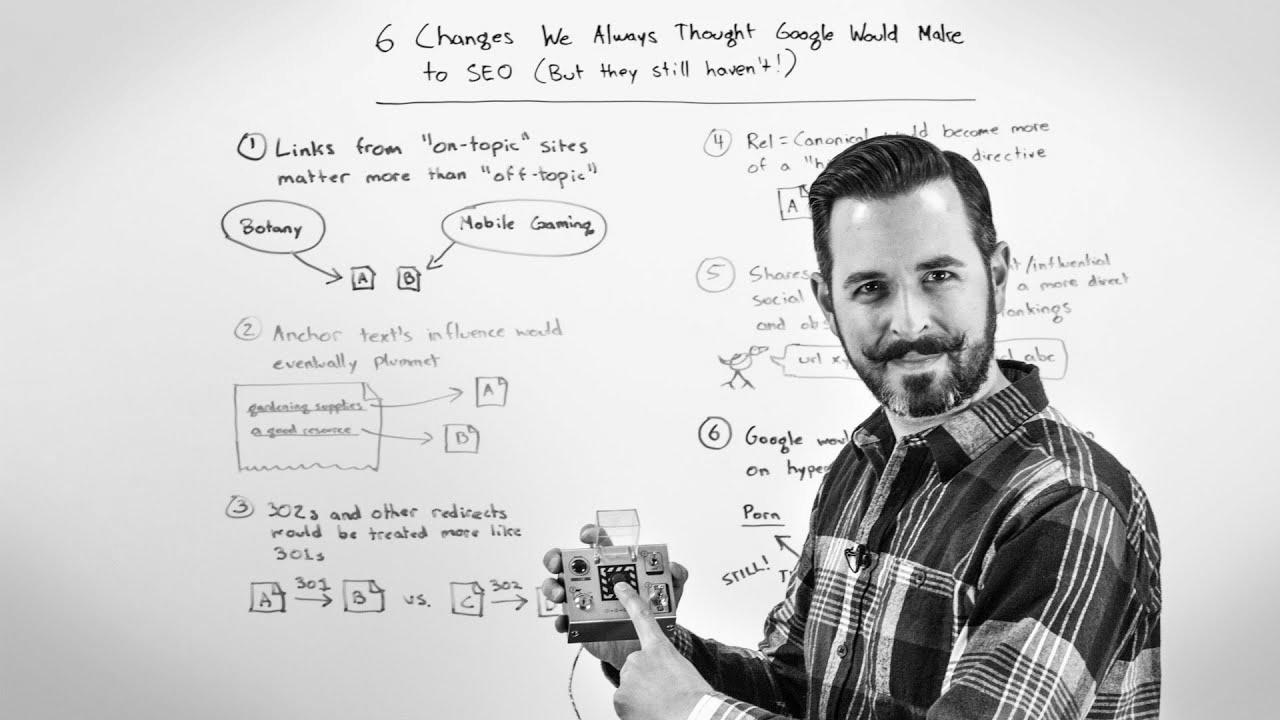

How To: 6 Changes We Thought Google Would Make to search engine marketing But They Still Have not – Whiteboard Friday

🤑Earn $30Day From Adsense – Rank #1 On Google With out search engine optimisation 🔥 Make Money On-line Hindi BloggingQnA